Wikipedia war über zwei Jahrzehnte das Standard-Nachschlagewerk im Netz — schnell, kostenlos und oft als erste Quelle in Suchergebnissen. Doch genau diese Vormachtstellung macht die Plattform heute zu einem politischen und technologischen Brennpunkt. Elon Musk hat mit seiner Alternative Grogipedia eine direkte Konkurrenz in Stellung gebracht, die bereits in Teilbereichen höher rankt als Wikipedia. Das sorgt für Aufruhr — nicht nur unter Nutzern, sondern auch bei einem der ursprünglichen Wikipedia-Gründer.

Worum es geht — kurz zusammengefasst

- Grogipedia ist eine von Elon Musk unterstützte Alternative zu Wikipedia und wird aktiv von ihm genutzt.

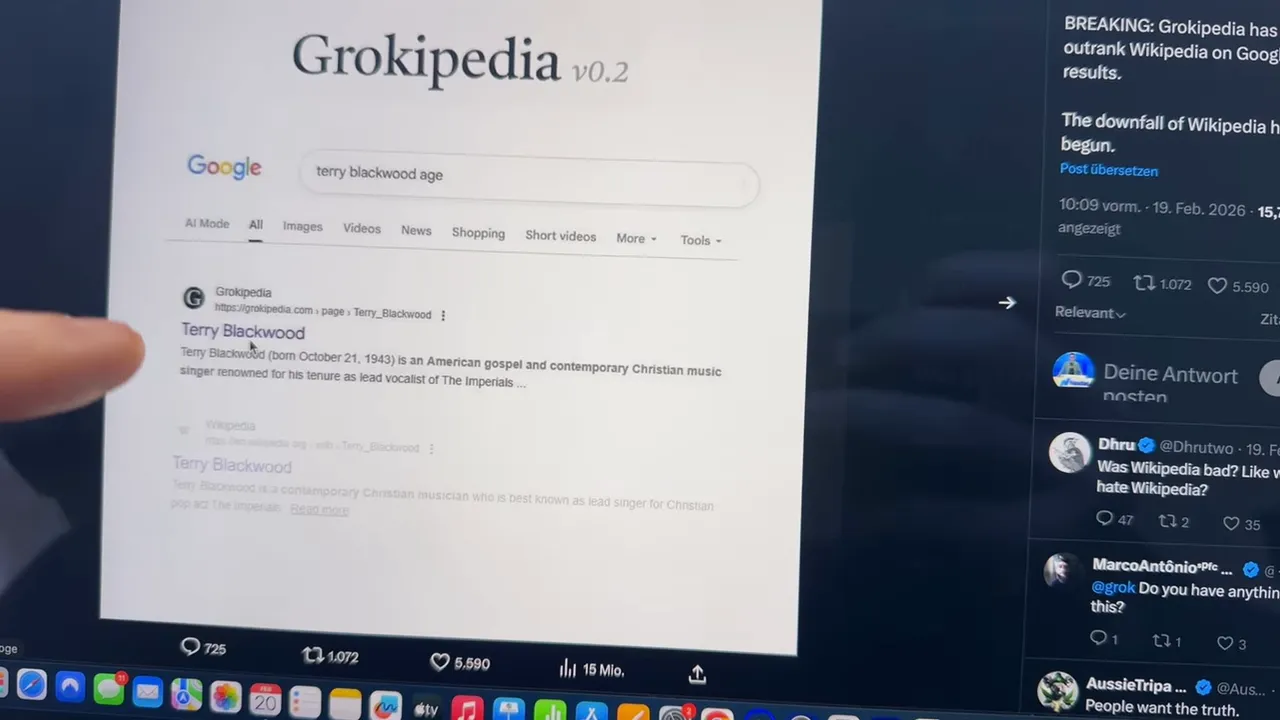

- Mehrere Beispiele zeigen, dass Grogipedia inzwischen in Google-Suchergebnissen vor Wikipedia auftaucht.

- Ein ehemaliger Mitgründer von Wikipedia, Larry Sanger, kritisiert eine politische Schieflage und spricht von einem Verfall der Neutralität.

- Die Problematik ist mehr als ein Streit um Online-Ego: Wikipedia-Daten füttern viele KIs — Bias in Wikipedia kann also Bias in KI-Tools verstärken.

Key takeaways

- Quelle ist Macht: Wer die ersten Treffer in Suchmaschinen kontrolliert, beeinflusst Auffassung und Diskurs.

- Neutralität ist kein Selbstläufer: Richtlinien müssen gepflegt und durchgesetzt werden — sonst entsteht systematischer Bias.

- Wettbewerb ist gesund: Alternative Plattformen wie Grogipedia können Kontrollmechanismen und Vielfalt in die Informationslandschaft bringen.

- Praxis-Tipp: Verlasse dich nicht auf einen einzigen Artikel — vergleiche mehrere Quellen, erstelle Backups und prüfe Referenzen.

Was ist Grogipedia — und warum ist sie relevant?

Grogipedia ist kein klassisches Wiki-Projekt, das in der Community langsam wächst und von Ehrenamtlichen gepflegt wird. Sie ist als Konkurrenzplattform positioniert, die darauf abzielt, die Informationshoheit von Wikipedia zu hinterfragen. Elon Musk hat die Seite bekannt gemacht und teilweise aktiv genutzt. Das allein wäre noch wenig überraschend, doch die Signale sind: Grogipedia erscheint vereinzelt in Suchergebnissen vor Wikipedia — ein Status, der Reichweite und Wahrnehmung massiv verändert.

Warum das wichtig ist: Viele Menschen stopfen ihr Wissen aus erster Hand in die Google-Suche ein. Steht dort ein Artikel ganz oben, prägt er die öffentliche Meinung. Und weil Suchergebnisse wiederum von Algorithmen und Trainigsdaten genutzt werden, kann die Reihung eine Rückkopplungsschleife erzeugen.

Die Kernkritik: Ist Wikipedia politisch voreingenommen?

Die zentrale Anschuldigung lautet: Wikipedia driftet weg von der einst propagierten Neutralität hin zu einer deutlich linken Perspektive — insbesondere bei politisch aufgeladenen Themen. Diese Kritik kommt nicht nur aus dem rechten Lager, sondern auch von einem der ursprünglichen Mitgründer: Larry Sanger.

„In the first five years there was a real effort at neutrality... and then it began a long, slow process slide into what I would call leftist propaganda.“

Frei übersetzt: In den Anfangsjahren sei Neutralität ernst genommen worden. Später hätten sich jedoch Quellenauswahl und redaktionelle Praxis verändert, sodass viele politische Artikel heute einen linksgerichteten Ton tragen.

Wie entsteht so eine Schieflage?

Drei Mechanismen, die diesen Prozess erklären:

- Quellenbias: Wikipedia beruft sich stark auf etablierte Medien. Wenn diese Medien eine Tendenz in eine Richtung haben, spiegeln Wikipedia-Artikel das wider.

- Editoren-Community: Wikipedia-Editoren sind Freiwillige mit eigenen Interessen und Weltanschauungen. Bei umkämpften Themen bilden sich oft aktive Gruppen, die die Kontrolle über Artikel übernehmen.

- Regelwerk und Moderation: Die Neutralitätsrichtlinie muss ausgelegt werden. Wenn die Community-Auslegung verschoben wird, verändert sich der Ton der Einträge.

Konkrete Beispiele, die die Debatte anheizen

Es gibt mehrere Vorfälle, die zeigen, wie sensibel die Lage ist:

- Bei bestimmten Suchanfragen tauchte Grogipedia bereits über Wikipedia in den Ergebnissen auf. Das betraf nicht nur Randpersonen, sondern auch Einträge mit politischen Implikationen.

- Ein Beispiel: Der Musiker Terry Blackwood erschien laut Beobachtungen zuerst mit einem Grogipedia-Eintrag über dem Wikipedia-Eintrag. Solche Fälle sorgen für Aufmerksamkeit, weil sie zeigen: Die neuen Plattformen sind mehr als ein Statement — sie verschieben tatsächlich, wer als erste Informationsquelle dient.

- Persönliche Erfahrungen: Autoren berichten, dass ihre Autorenseiten auf Wikipedia gelöscht wurden mit der Begründung mangelnder Relevanz — selbst wenn die Betroffenen offensichtlich Bücher verkauft oder publiziert haben. Das ist ein Beispiel für Gatekeeping: Entscheider in der Community definieren „Relevanz“ nicht rein nach Fakten, sondern nach internen Kriterien.

Solche Lösch-Entscheidungen wirken willkürlich und stärken die Wahrnehmung einer politischen Schlagseite. Wenn erfolgreiche Autoren als „nicht relevant“ eingestuft werden, schwindet das Vertrauen in die Fairness des Systems.

Warum das Thema auch gesellschaftlich und technologisch wichtig ist

Die Konsequenzen gehen weit über ein rein akademisches Streitgespräch hinaus. Zwei Punkte sind besonders wichtig:

1. Einfluss auf die öffentliche Meinung

Wikipedia-Artikel sind oft die erste Anlaufstelle für Journalisten, Politiker und Bürger. Sie werden zitiert, verlinkt und weiterverarbeitet. Wenn diese Inhalte einseitig sind, färbt das die Debatte. Besonders bei Wahlkampf- oder Polarisierungsthemen kann das erheblichen Einfluss haben.

2. Training von künstlichen Intelligenzen

Viele große KI-Modelle wurden mit öffentlichen Webseiten und Enzyklopädie-Daten trainiert. Wikipedia ist eine reichhaltige, strukturierte Datenquelle — und damit ein gewichtiger Faktor beim Lernen von Sprachmodellen. Ist Wikipedia in bestimmten Themenbereichen voreingenommen, reproduzieren KI-Modelle diese Tendenzen. Nutzer, die sich auf Antworten von Chatbots verlassen, bekommen so möglicherweise bereits vorgefilterte Sichtweisen serviert.

Das führt zu zwei Problemen:

- Skalierung des Bias: Ein einmal vorhandener Bias multipliziert sich durch KI-Dienste, die weltweit eingesetzt werden.

- Schwierigkeit der Korrektur: KI-Antworten wirken autoritativ; Anwender hinterfragen sie nicht automatisch. Fehler oder Schieflagen lassen sich dann schwer zurückverfolgen und korrigieren.

Wie man sich als Nutzer schützt — praktische Schritte

Ob man Wikipedia mag oder nicht — wir alle nutzen das Internet zur Informationssuche. Deshalb ist es sinnvoll, ein paar Werkzeuge und Arbeitsweisen zu kennen, um neutralere, robustere Urteile zu fällen.

1. Mehrere Quellen vergleichen

Verlasse dich nicht auf einen einzigen Artikel. Wenn ein Thema wichtig ist — für eine Arbeit, einen Artikel oder eine Entscheidung — vergleiche:

- Wikipedia-Artikel (aktuelle Version und Versionen aus der Versionsgeschichte)

- Alternative Enzyklopädien und spezialisierte Nachschlagewerke

- Fachartikel, Primärquellen, offizielle Dokumente

- Unabhängige Blogs, investigative Artikel, wissenschaftliche Studien

2. Versionsgeschichte und Diskussion lesen

Die Versionsgeschichte eines Wikipedia-Artikels zeigt, wie sich der Inhalt entwickelt hat. In den Diskussionsseiten wird oft offen gestritten — dort erkennt man, welche Aussagen umstritten sind und wie die Community argumentiert.

3. Quellen prüfen

Schau dir jede Referenz an: Ist sie seriös? Handelt es sich um eine Meinungsseite? Ist die Quelle primär oder sekundär? Wenn bei politischen Themen fast alle Quellen aus einem Lager stammen, weckt das Misstrauen.

4. Reverse-Search und Kontext

Such Bilderquellen rückwärts, überprüfe Zitate im Kontext und achte auf Datum und Autor. Viele Missverständnisse entstehen durch veraltete oder aus dem Kontext gerissene Informationen.

5. Archiv-Tools nutzen

Webarchive wie die Wayback Machine können helfen, frühere Versionen von Webseiten oder Artikeln zu prüfen. So lässt sich leichter erkennen, ob ein Artikel über die Zeit „umgeschrieben“ wurde.

Wie man selbst zur Verbesserung beitragen kann

Wenn dich eine falsche oder einseitige Darstellung stört, gibt es zwei Möglichkeiten: motzen oder mitmachen. Die zweite ist wirkungsvoller.

So trägst du sauber und effektiv bei

- Registrieren: Ein Benutzerkonto erhöht Transparenz und Glaubwürdigkeit.

- Quellen sammeln: Bevor du Änderungen vornimmst, lege solide, unabhängige Quellen parat.

- Diskussion statt Provokation: Nutze die Diskussionsseite, erkläre sachlich und verlinke Quellen.

- Small wins zuerst: Beginne mit harmloseren Korrekturen (Tippfehler, veraltete Zahlen) und arbeite dich zu größeren inhaltlichen Punkten hoch.

- Transparenz: Gib immer an, warum du etwas änderst — das reduziert den Widerstand.

Zu wissen, wie man Artikel professionell bearbeitet, kann den Unterschied ausmachen zwischen sofortiger Zurücksetzung und nachhaltiger Änderung.

Checkliste: Wie du Artikel schnell auf Bias prüfst

- Wer sind die zitierten Quellen? Vielfalt oder Einseitigkeit?

- Wie ist die Tonalität? Vereinfachend, emotional oder neutral?

- Existiert eine Versionsgeschichte mit häufigen Edit-Kriegen?

- Gibt es offene Diskussionen über die Relevanz einzelner Abschnitte?

- Sind Behauptungen belegt oder mit schwammigen Formulierungen versehen?

- Wie aktuell sind die Informationen?

Was Grogipedia für das Informations-Ökosystem bedeutet

Konkurrenz belebt das Geschäft. Grogipedia hat das Potenzial, einen Prüfstein gegen mögliche Verzerrungen zu bieten. Selbst wenn die neue Plattform eigene Probleme hat — etwa bei Moderation oder Qualitätssicherung — zwingt sie etablierte Plattformen dazu, genauer hinzusehen. Aus marktwirtschaftlicher Sicht ist das positiv: Wenn Nutzer zur besseren Alternative wechseln, muss die alte Plattform nachbessern.

Ein weiterer Effekt: Wenn mehrere Plattformen unterschiedliche Narrative bieten, wird es schwieriger, einseitige Monopole auf die Wahrheit zu beanspruchen. Das bedeutet aber auch: Nutzer müssen lernen, Quellenkompetenz zu entwickeln; Fragmentierung macht kritisches Denken wichtiger.

Risiken und Nebenwirkungen der Fragmentierung

Mehr Auswahl ist gut, aber sie kann auch Polarisierung verstärken. Wenn Nutzer nur noch Plattformen konsumieren, die ihre Sicht bestätigen, entsteht eine Echokammer. Information wird dann weniger zu einem gemeinschaftlichen Fonds von überprüften Fakten, sondern zu einem Markt für konkurrierende Narrative.

Deshalb bleibt ein zentraler Punkt: Qualitätssicherung, Transparenz und Nachvollziehbarkeit in Quellenangaben. Plattformen, die diese Kriterien vernachlässigen, verlieren langfristig Vertrauen.

Mögliche Szenarien für die Zukunft

Szenario 1: Wikipedia reformiert sich

Wikipedia könnte auf die Kritik reagieren: Transparenteres Moderationsverhalten, bessere Durchsetzung der Neutralitätsrichtlinien und ein stärkeres Gewicht für diversere Quellen. Eine aktive Community, die stärker auf Ausgewogenheit achtet, würde den größten Effekt haben.

Szenario 2: Mehr starke Alternativen entstehen

Grogipedia könnte nur der Anfang sein. Wenn alternative Plattformen Qualitätskontrollen etablieren und in Suchmaschinen bessere Sichtbarkeit gewinnen, entsteht ein pluralistisches Ökosystem. Die Konkurrenz zwingt jedes Projekt zu Verbesserungen.

Szenario 3: Polarisierung und Fragmentierung

Gelingt es nicht, Qualitätsstandards in allen Lagern durchzusetzen, droht Fragmentierung. Nutzer suchen zunehmend bestätigende Quellen, Falschinformationen können schneller zirkulieren und KIs werden mit heterogenen, teilweise widersprüchlichen Trainingsdaten gespeist. Die Folge: Unübersichtlichkeit und ein schwächeres gemeinsames Faktenfundament.

Konkrete Empfehlungen für Entscheider und Informationsnutzer

- Für Lehrende und Forschende: Lehre Quellenkritik aktiv. Setze klare Bewertungsmaßstäbe für digitale Quellen.

- Für Entwickler von KI: Berücksichtige Quellenvielfalt beim Training und prüfe, wie sich Bias in Ausgangsdaten auf Modellantworten auswirkt.

- Für Journalisten: Nicht blind zitieren. Dokumentiere die Recherchestruktur und prüfe Versionshistorien.

- Für Bürger: Nutze Vergleichsseiten, prüfe Referenzen, hinterfrage Delete-Entscheidungen und beteilige dich, wenn möglich, konstruktiv an Plattformen.

Warum aktive Beteiligung wichtiger ist denn je

Eine Enzyklopädie lebt von Beiträgen. Wenn Nutzer sich beschweren, ohne zu helfen, bleibt die Situation gleich oder verschlechtert sich. Wer die Informationslandschaft verbessern will, muss selbst mitarbeiten: Quellen bereitstellen, Diskussionen führen, Fehler dokumentieren.

Die Kritik an Wikipedia ist ernst zu nehmen. Sie ist aber auch eine Chance: Diskussionen über Neutralität, Transparenz und KI-Ethik führen dazu, dass Informationsplattformen sich weiterentwickeln müssen. Menschen, die sich engagieren, können diese Entwicklung aktiv mitgestalten — und damit einen Beitrag zur Qualität der öffentlichen Debatte leisten.

Was du heute tun kannst

- Such ein aktuelles Thema, das dich interessiert. Lies mindestens drei verschiedene Enzyklopädie- oder Nachschlageartikel.

- Prüfe die Referenzen in jedem Artikel — sind sie vielfältig und seriös?

- Schau dir die Versionsgeschichte an: Gab es viele Reverts oder Edit-Wars?

- Wenn du einen Fehler findest: Korrigiere ihn, diskutiere sachlich, oder lege die Quellen offen.

- Wenn du mit KI-Tools arbeitest: Teste Antworten auf Bias, vergleiche mit Primärquellen und melde problematische Antworten.

Gedanken zum Schluss

Der „Kampf“ um Wikipedia ist mehr als ein Streit zwischen Tech-Milliardären und Online-Enzyklopädisten. Er ist ein Indikator für einen grundlegenden Wandel: Wer erzeugt Wahrheit und wie verlässlich ist sie? Plattformen wie Grogipedia tragen dazu bei, die Frage neu zu stellen. Am Ende entscheidet aber nicht allein die Technologie, sondern die breite Öffentlichkeit — durch kritisches Denken, aktive Mitarbeit und die Bereitschaft, Quellen zu prüfen.

Nutze die Chance, informierter zu werden: Hinterfrage, vergleiche, trage bei. Information ist keine fertige Ware. Sie ist ein Prozess — und jeder kann daran mitwirken, ihn besser zu machen.

Dieser Artikel wurde mithilfe von KI aus dem Video Elon Musk: Kampf gegen Wikipedia eskaliert! erstellt.

Elon Musk: Kampf gegen Wikipedia eskaliert!. There are any Elon Musk: Kampf gegen Wikipedia eskaliert! in here.